Qual é a diferença entre ASCII e Unicode?

Publicados: 2022-04-10ASCII e Unicode são os padrões de codificação de caracteres mais conhecidos atualmente em uso em todo o mundo. Ambos os programas são extremamente importantes nas comunicações modernas. Ao usar um dispositivo de comunicação eletrônica, os dados passam pela unidade central de processamento que melhora o desempenho do sistema usando a memória principal e cache. Os periféricos utilizam interfaces para comunicação entre o sistema e um dispositivo conectado. Ambos os caracteres padrões de codificação podem ser representados em binário. Os caracteres são normalmente agrupados em um conjunto de caracteres. Um conjunto de caracteres inclui:

- dados alfanuméricos (letras e números)

- símbolos (*, &, : etc.)

- caracteres de controle (Backspace, guia Horizontal, Escape, etc.

Um conjunto de caracteres é uma seleção de caracteres, enquanto uma codificação de caracteres é um gráfico onde um conjunto de caracteres e um valor são representados digitalmente (ex: A=1, B=2). O padrão ASCII é essencialmente ambos: define os conjuntos de caracteres que representa e um método de atribuir um valor numérico a cada caractere. A palavra Unicode, por outro lado, é usada em vários contextos diferentes para significar coisas diferentes. Pense nisso como um termo abrangente para se referir a um conjunto de caracteres e codificações de números. No entanto, como existem várias codificações, o termo Unicode é normalmente usado para se referir ao conjunto geral de caracteres, em vez de como eles são representados no gráfico.

Recursos de ASCII e Unicode

ASCII

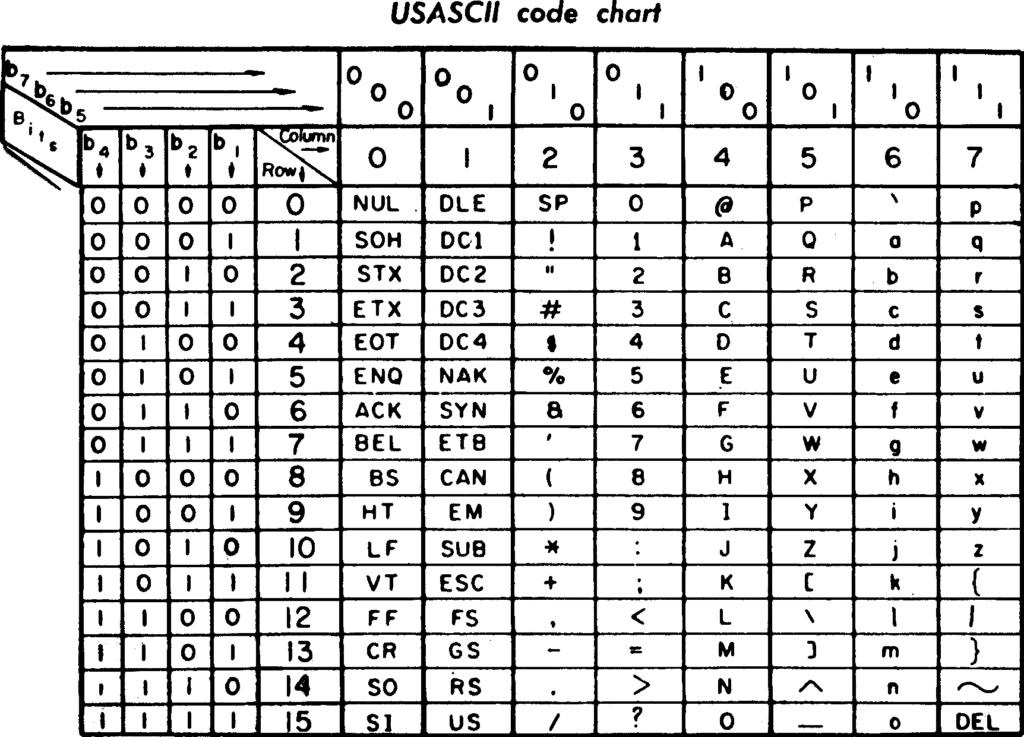

O ASCII (American Standard Code for Information Interchange) foi lançado pela primeira vez em 1963. Possui 128 caracteres codificados, que são principalmente na língua inglesa que são usados em computadores de programação modernos. Por não ter sido atualizado desde a sua criação, o ASCII ocupa menos espaço. Ele utiliza 7 bits de dados para codificar qualquer caractere, foi usado principalmente para codificação de caracteres na World Wide Web e ainda é amplamente usado para programas de computador modernos como HTML.

Ele codifica o texto convertendo-o em números porque os números são mais fáceis de armazenar na memória do computador do que o alfabeto. Há também uma versão alternativa conhecida como ASCII estendido. Com esta técnica, é possível usar o bit mais significativo de um byte de 8 bits para permitir que o ASCII apresente 256 caracteres. Os programadores usam o conjunto de caracteres de design para simplificar certas tarefas. Por exemplo, usando códigos de caracteres ASCII, alterar um único bit converte facilmente o texto de maiúsculas para minúsculas. Ele também usa alguns caracteres de controle não imprimíveis que foram inicialmente destinados ao uso com terminais de impressão de teletipo.

Unicode

O processo Unicode (Universal Character Set), armazena e facilita a troca de dados de texto em qualquer idioma é considerado o padrão de TI utilizado para codificação. Unicode representa e manipula o texto para computadores, smartphones e outros equipamentos tecnológicos. Ele codifica uma variedade de caracteres, incluindo uma ampla variedade de texto em vários idiomas, incluindo árabe, hebraico e grego, scripts históricos, símbolos matemáticos etc. O Unicode também suporta um número substancial de caracteres e ocupa mais espaço em um dispositivo, portanto, a programação ASCII faz parte do Unicode. O Unicode utiliza 16 bits para representar os caracteres usados com mais frequência em vários idiomas. Os desenvolvedores normalmente trocam dados usando um conjunto de código simples sem conversões de código complexas para ler caracteres.

O suporte para Unicode oferece muitos benefícios, incluindo:

- Fonte global e binário.

- Suporte para ambientes de computação de script misto.

- Melhor interoperabilidade de dados entre plataformas por meio de um conjunto de códigos comum.

Fácil de usar

ASCII

- Universalmente aceito

- Como o ASCII usa um conjunto básico de caracteres para comunicações básicas, os desenvolvedores podem projetar interfaces que os computadores e as pessoas possam compreender. ASCII codifica uma cadeia de dados como caracteres ASCII que podem ser explicados e apresentados como dados para computadores ou texto legível planejado para pessoas. O conjunto de caracteres ASCII pode ajudar a simplificar certas tarefas para programadores.

- Codificação de caracteres compacta

- Os códigos padrão podem ser expressos em 7 bits, o que significa que os dados podem ser expressos no conjunto de caracteres ASCII padrão. Isso requer apenas tantos bytes para enviar ou armazenar quantos os números nos dados.

- Eficiente para programação

- Os códigos de caracteres ASCII estão bem adaptados às técnicas de programação para alterar texto e utilizar números para cálculos ou armazenamento como dados brutos.

Unicode

- Processo de inscrição simplificado

- Todos os símbolos são requeridos pelo aplicativo para escrever e ler dados de caracteres dentro de uma página de código individual. Isso simplifica tremendamente o desenvolvimento de aplicativos.

- Fácil transferência de código existente

- Como existem caracteres ASCII tradicionais em suas primeiras 127 posições, o programa aloca cada um desses caracteres ao seu valor ASCII original.

- Compatibilidade com a Web

- Como o Unicode está rapidamente se tornando a página de código universal da Web, todos os padrões atuais da Web dependem dele.

- Aplicativos multilíngues

- Os aplicativos que usam Unicode podem oferecer suporte a vários idiomas tanto em dados quanto na interface do usuário.

- Interoperabilidade

- Clientes Java e Active-X são ambos baseados em Unicode, para que possam se comunicar com AppServers e bancos de dados UTF-8.

Empresa por trás do produto e suporte

ASCII

Em abril de 2008, a MediaWorks, Inc. foi legalmente absorvida pela ASCII Corporation e formou a ASCII Media Works, Inc.

Unicode

O Unicode Consortium é uma corporação sem fins lucrativos que desenvolve, mantém e promove a internacionalização de software, incluindo a definição de comportamento e relacionamentos entre caracteres Unicode.

Alternativas

- AppleScript

A Apple criou uma linguagem de script chamada AppleScript em 1993. Ela permite que os usuários controlem aplicativos Macintosh programáveis. Ele também permite que os usuários controlem aplicativos Macintosh com script diretamente e partes do macOS. Você pode criar fluxos de trabalho complexos, criar scripts, automatizar tarefas repetitivas, combinar recursos de vários aplicativos com script e definir instruções escritas. O AppleScript oferece um número limitado de comandos. No entanto, ele também fornece uma estrutura na qual você pode conectar vários comandos específicos de tarefas (fornecidos por partes programáveis do macOS e aplicativos programáveis. O AppleScript 2.0 agora é inteiramente baseado em Unicode e contém todos os caracteres Unicode e é preservado corretamente, independentemente da preferência de idioma.

Conclusão

Então qual é melhor? Todos e todos, tanto ASCII quanto Unicode são extremamente úteis, mas, em última análise, a escolha é sua com base em suas preferências e requisitos. ASCII é ótimo ao trabalhar com um pequeno número de caracteres fornecidos pela técnica, pois precisa de menos espaço que o Unicode. O Unicode está em alta demanda devido à sua grande variedade de recursos e funções e é mais fácil de usar. Ambas são excelentes técnicas de codificação para diferentes aplicações.